A heart rate variability-driven framework for depression screening leveraging emotion-elicited autonomic dissociation

基於心率變異性驅動之情緒誘發自主神經分離的憂鬱症篩檢框架

摘要

- 本研究關注:在「情緒誘發」條件下,憂鬱傾向個體的自律神經(以 HRV: heart rate variability 表徵)是否會出現可用於篩檢的可分辨差異,以及「哪一種情緒」最能拉開差距。

- 受試者在同一套情緒誘發流程下觀看影片並填寫主觀量表(SAM),同步收集 ECG,再萃取 9 個可計算 HRV 特徵作分析與建模。

- 主要發現:

- 各情緒刺激皆能成功誘發目標情緒 👉 主觀量表上對應情緒分數上升、其他情緒維度相對較低;喚醒度也足夠 👉 證明刺激有效

- 組間差異的關鍵落在:悲傷 (sadness) 誘發時,疑似憂鬱個體呈現更強的反應性 👉 悲傷增加顯著

- 而快樂 (happiness) 反應減弱的預期趨勢,作者認為並未被清楚示範 👉 快樂減弱不顯著

- 以情緒條件建構的 ERTC(Extremely Randomized Trees Classifier)模型中,悲傷誘發表現最佳(Acc=76.8%,AUC ≈ 0.78);其餘情緒(憤怒、快樂、恐懼)約落在 68–73%ACC;平靜(近似 resting)基準最低。

研究背景與動機:為什麼要「用情緒誘發」做篩檢?

- 傳統以靜息(resting)或一般狀態 HRV 直接做分類,常遇到兩個問題:

- 個體差異(inter-individual variability)過大,導致訊號差異被「人與人本來就不同」淹沒

- 刺激材料冗餘:不是每一個 標準化情緒誘發流程刺激,都能有效區分 HCs 與 IWDs(individuals with suspected depression)

- 因此作者提出一個核心策略:

- 以「平靜」作為個體內基線,將其他情緒狀態的 HRV 反應用 baseline-referenced 的方式標準化(z-score) 👉 提升「情緒反應本身」的可辨識性

- 然後比較:不同情緒條件下,哪一個最能放大憂鬱相關的自律神經差異,並用於建模篩檢

研究方法:受試者、實驗流程、訊號處理、統計與機器學習

受試者與分組標準

-

受試者:大學生或研究生(年齡約 22 歲上下)157位參與者:

-

HCs:PHQ-9 總分 ≤ 4(視為非憂鬱/健康) :66人

- 27 名男性,39 名女性

- 21.80 ± 2.61 歲

-

IWDs:PHQ-9 總分 ≥ 10(高度疑似憂鬱):30人

- 12 名男性,18 名女性

- 22.96 ± 2.43 歲

-

-

PHQ在5~9分 👉 作者沒寫,應該沒納進去做計算(可調數據)

-

樣本篩選背景:

- 研究團隊最初進行了檢定力分析(Power Analysis),估算最低僅需 32 名參與者(每組 16 人)即可達到統計要求 👉 這是啥,好像是統計

- 但最終實際招募並分析的樣本量遠超此標準,直到獲得 30 例有效的憂鬱症個案後才停止招募。

- 在正式實驗前,研究團隊還另外招募了約 70 名 參與者進行前導測試,用於評估和篩選能有效誘發情緒的影片材料(這部分樣本與正式實驗的 157 人是分開的)👉 用來確認刺激有效

情緒刺激材料(影片)

- Table 1(作者列出的刺激素材範例;影片情緒類別與時長):

-

Calmness(平靜):192s,「一家人的日常生活」

-

Anger(憤怒):

- 《甘地》,123s,「印度律師被從頭等車廂趕下火車」

- 《我的保鏢》,101s,「一群惡霸挑釁一名少年」

-

Happiness(快樂):

- 《天外奇蹟》,67s,「卡爾……遇見充滿活力的艾莉」

- 《楚門的世界》,60s,「到海邊度過浪漫夜晚」

- 《瓦力》,93s,「瓦力與伊芙共度浪漫的一夜」

-

Fear(恐懼):

- 《鬼店》,78s,「一個孩子進入飯店房間尋找媽媽」

- 《黑天鵝》,62s,「一名女子注意到身邊出現超自然現象」

-

Sadness(悲傷):

- 《我的女孩》,66s,「一名年輕女孩在朋友的葬禮上哭泣」

- 《小鹿斑比》,166s,「斑比的母親被獵人射殺」

-

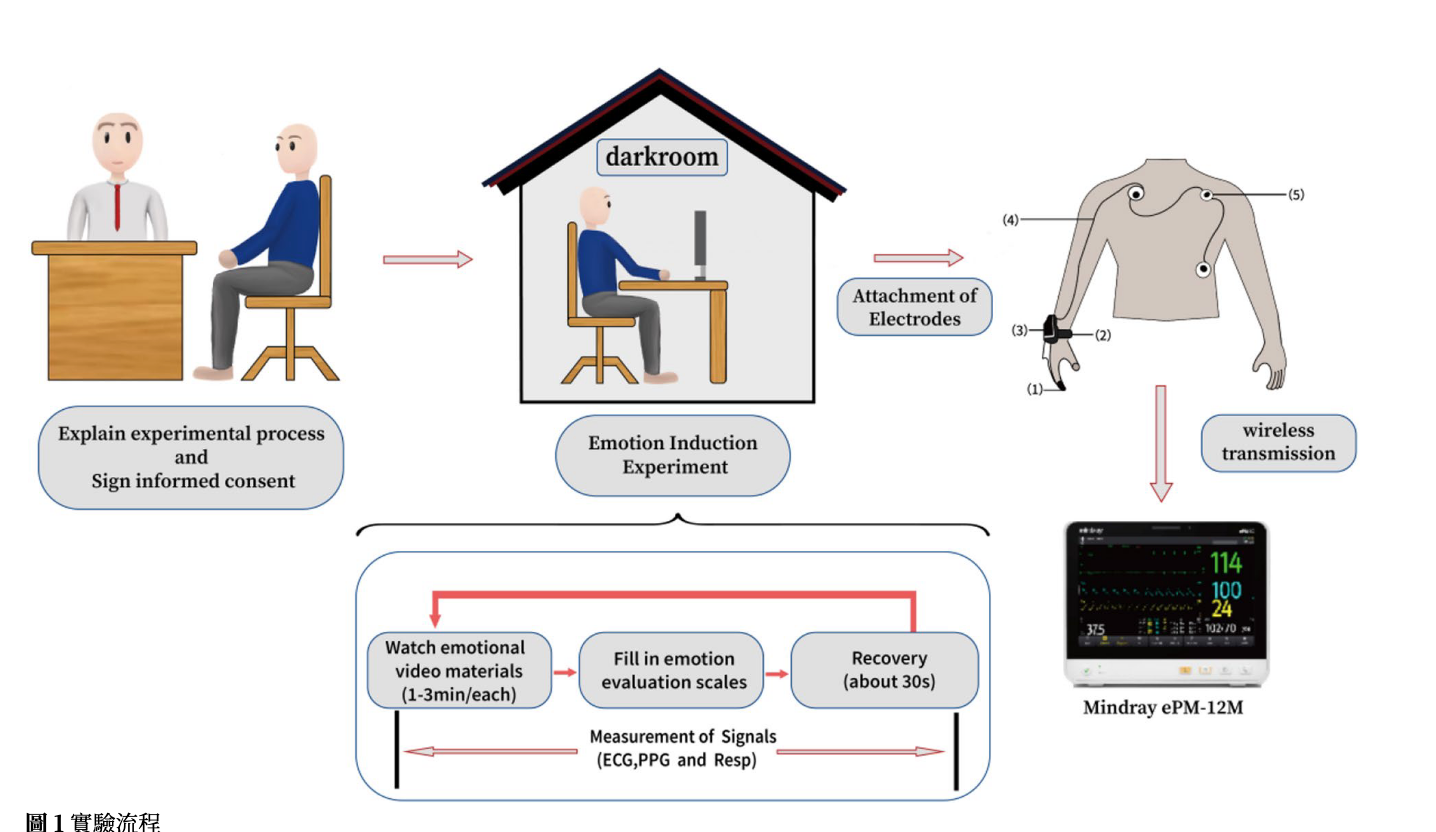

實驗流程(情緒誘發 + 主觀量表)

-

受試者在暗室(僅留螢幕光源)完成 7 段影片試次(每段流程:觀看影片 → 自評 → 休息)

-

影片情緒效價固定順序(valence sequence):

- calm → positive → negative → positive → negative → positive → negative 👉 正負輪替

- positive =

happiness - negative 影片用來誘發

sadness/fear/anger(具體片段對每位受試者隨機抽換,但效價順序固定)

-

每次影片後填寫 Self-Assessment Manikin (SAM):

- 6 個 9-point scales:

- 4 個離散情緒強度:

happiness/sadness/fear/anger - 1 個

arousal(喚醒) - 1 個

valence(愉悅度/效價)

- 4 個離散情緒強度:

- 6 個 9-point scales:

ECG 蒐集與前處理

-

電極位置(3 電極):

- 左鎖骨中點下方

- 右鎖骨中點下方

- 左下腹最低肋骨下方

-

ECG 取樣率:500 Hz(醫療級設備 ePM-12M, Mindray)

-

濾波:

- band-pass filter:0.5–100 Hz(去除 baseline wander 等)

- notch filter:50 Hz(去除電源干擾)

-

R-peak 偵測:使用 Neurokit2 實作之演算法 👉 跟ISI原始HRV處理一致

-

註:EEG濾波目前沒找到更新、用DL做過濾的文獻

-

切段(segmentation):

- 依刺激呈現的 timestamps 將連續訊號切成每段影片對應區間

- 每段刺激區間尾端取出不重疊的 1 分鐘 epoch(non-overlapping 1-min epochs)供後續 HRV 計算 👉 (ISI用30秒,因為時間原本就短)

- 作者也提醒:因 epoch 長度限制,部分 HRV 指標不適用或不計算 👉 特別是需要看長時間變化的HRV

HRV 特徵

- 本研究使用 9 個「可在 1 分鐘計算」的常見 HRV 特徵 + 呼吸速率(透過 HRV-HF 間接估計):

- MeanNN:NN intervals 平均

- SDNN:NN intervals 標準差

- RMSSD:相鄰 NN 差的均方根

- CVNN:SDNN / MeanNN

- CVSD:RMSSD / MeanNN

- LFn:normalized low frequency(LF power / total power)

- HF power / total power(文中描述疑似有字面錯誤;概念上應為 )

- LF/HF:LF power / HF power

- Resp_Rate:由 HRV-HF 間接估計之呼吸速率

以「平靜」為個體內基線的標準化(baseline-referenced z-score)

- 目的:降低個體間差異、凸顯同一個人「被情緒誘發後」的變化

- 作法:對每位受試者,以 calm 的均值與標準差作參照,把其他情緒 epoch 的特徵轉成 z-score:

- 直覺:看「偏離自己平靜狀態多少個標準差」,而不是直接拿生理絕對值互比

統計分析:先看特徵差異再建模 👉 這部分都是統計,ISI研究直接跑Lasso

- 先做 HRV 特徵分佈檢視與統計比較:

- 使用 Mann–Whitney U test(SciPy)

- p-values 做 FDR correction(多重比較控制)

- 目的:確認哪些情緒條件下,HRV 反應在組間/組內呈現系統性差異(以及差異方向)

機器學習建模:為每個情緒條件建立「情緒特定」模型

- 先在小型隨機子集評估多個 ML 演算法:

- SVM、KNN、Decision Tree、Random Forest、Extremely Randomized Trees Classifier (ERTC)

- 結果 ERTC 最佳 → 選定為主要模型 (類似RF,但是比RF更隨機)

- 實作工具:Scikit-learn

- 資料切分:train/test = 7:3

- 訓練策略:

- 5-fold cross-validation(降低 overfitting) 👉 大量樣本會在同一個set裡面

- Bayesian optimization 調參(ERTC hyperparameters)👉 貝葉斯優化,超參數調整(如果決定特定模型Ex.MLP 可以用)

- 另外建立對照:

- calm-state(不做情緒誘發,或等同 resting 的基準模型)

- 拿靜息態HRV去做訓練,證明「故意讓受試者看悲傷影片」所測得的生理訊號,比傳統的「靜靜坐著測量(Resting state)」更能準確抓出憂鬱症。

- logistic regression 作為 ERTC 的 control model 👉 比較LR跟ERTC哪個好

- calm-state(不做情緒誘發,或等同 resting 的基準模型)

- 評估指標:

- accuracy、AUC、precision 等

- ROC curve

結果:情緒誘發有效性、差異模式、模型表現

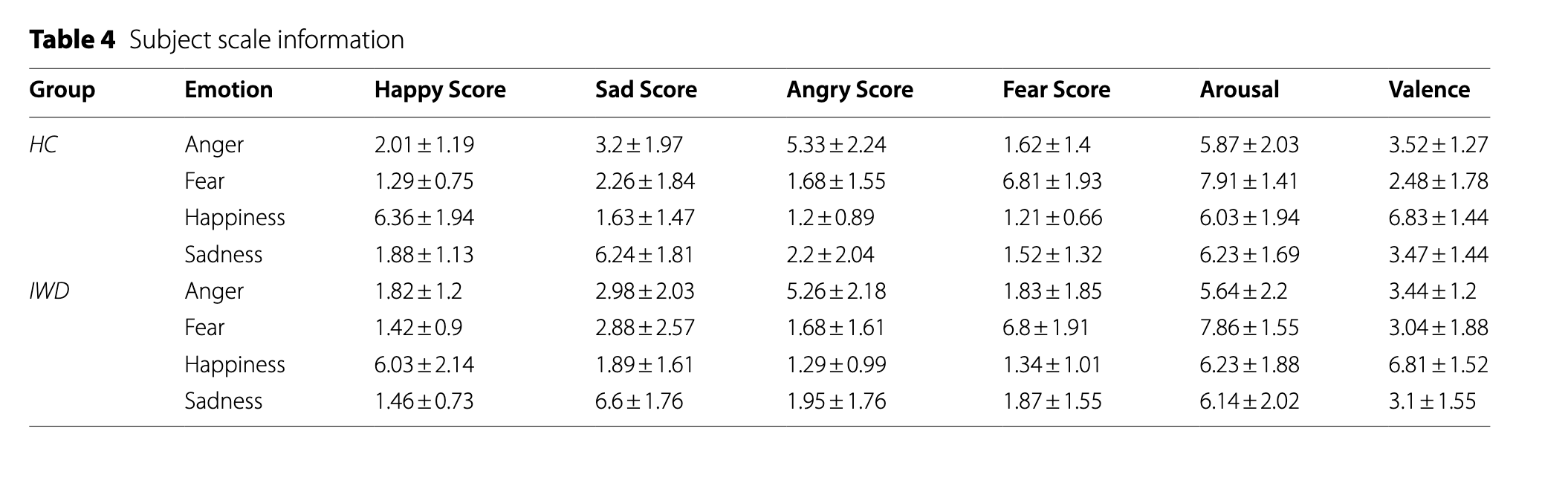

主觀量表(SAM):情緒誘發有效

- 作者指出:在所有情緒誘發條件下,目標情緒維度分數顯著高於其他維度,且 arousal 充足 👉 確認刺激&主觀感受一致

- 組間主觀量表差異(摘要式敘述):

- 不同刺激下,在某些情緒/效價評分上可見 HCs 與 IWDs 的差異(例如特定刺激下的 valence、或對應情緒的強度差)

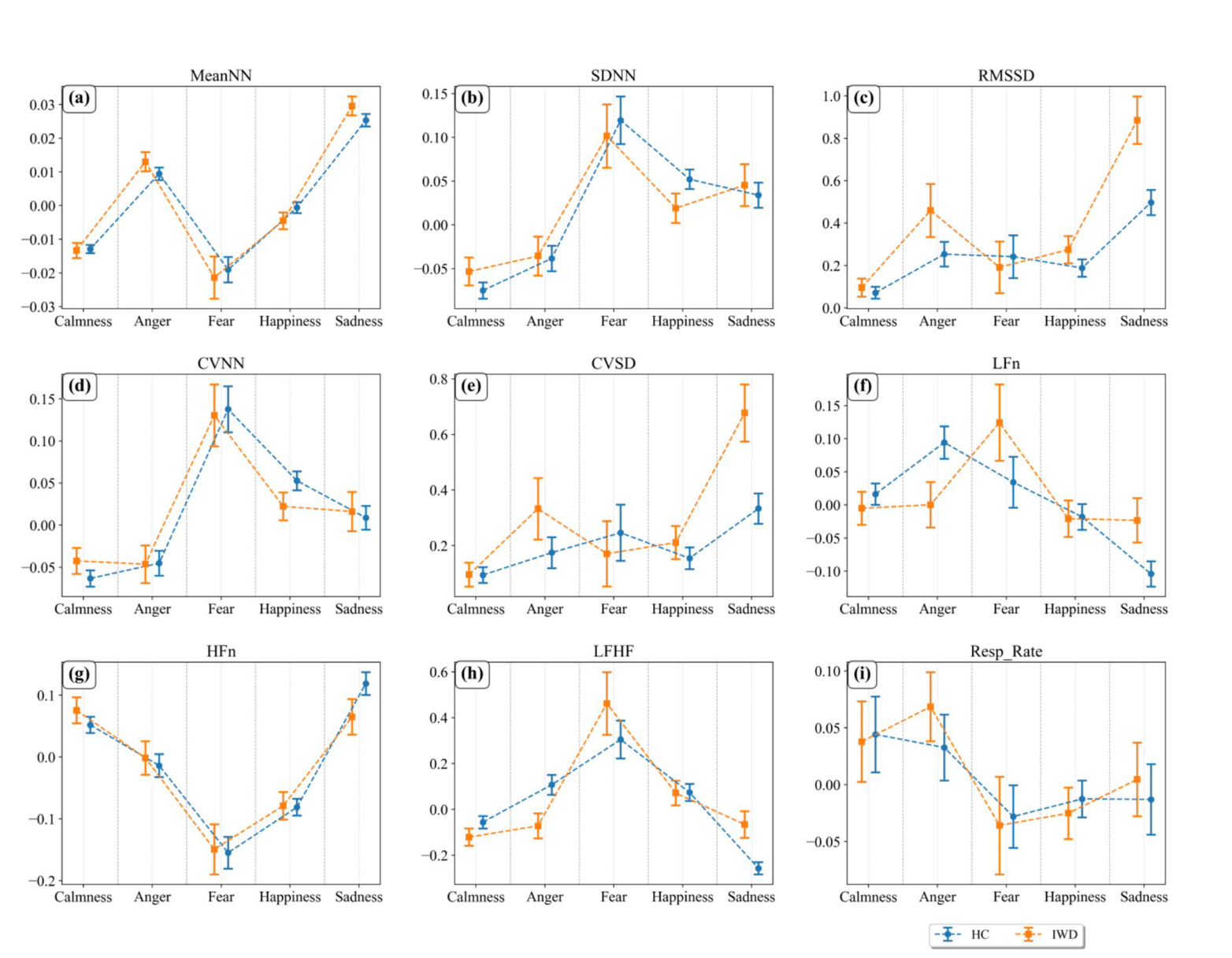

HRV:多數特徵方向趨勢一致,但關鍵差異落在 sadness / happiness

- Table 5 彙整了各 HRV 特徵在不同情緒條件下的變化與顯著性(含組內變化、組間差異)

- 作者的綜合結論是:

- 多數 HRV 特徵在 HCs 與 IWDs 之間,呈現「大致一致」的方向性反應

- 但關鍵差異在於:

- 悲傷誘發在 IWDs 中出現更強的反應性(heightened sadness reactivity)

- 快樂誘發在 IWDs 中「反應減弱」的預期,作者說在 HRV 層面並沒有很清楚地被示範(可能與刺激設計/主觀體驗差異等因素有關)

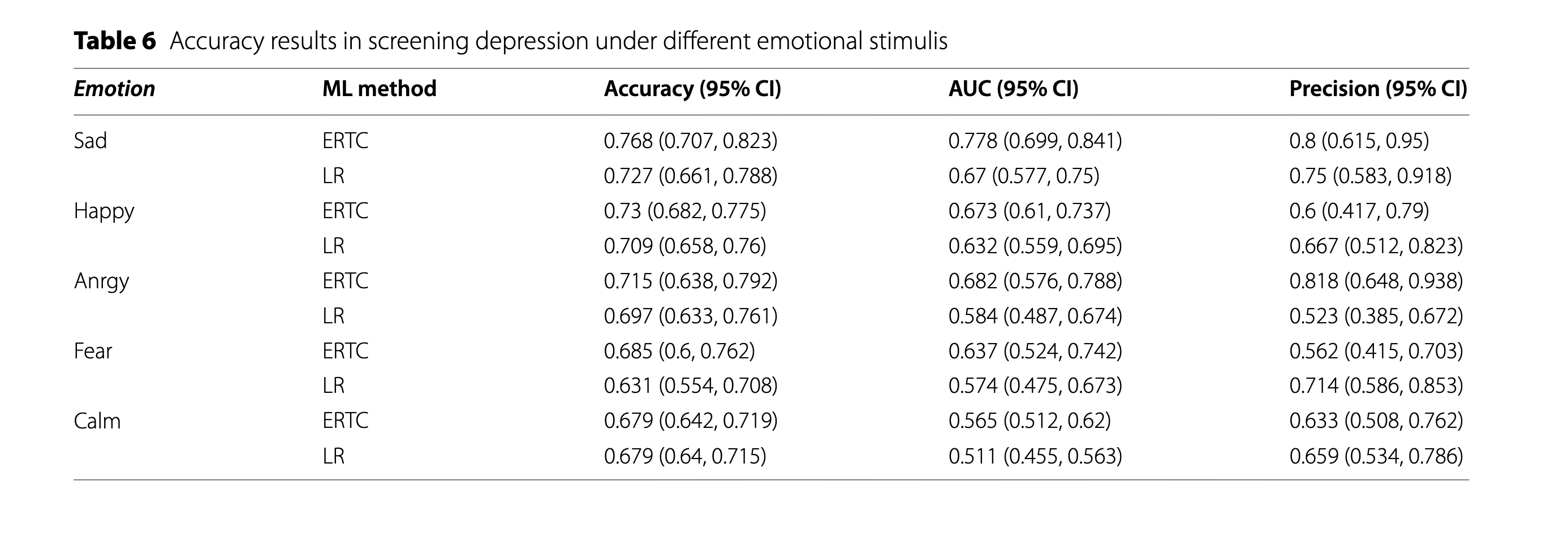

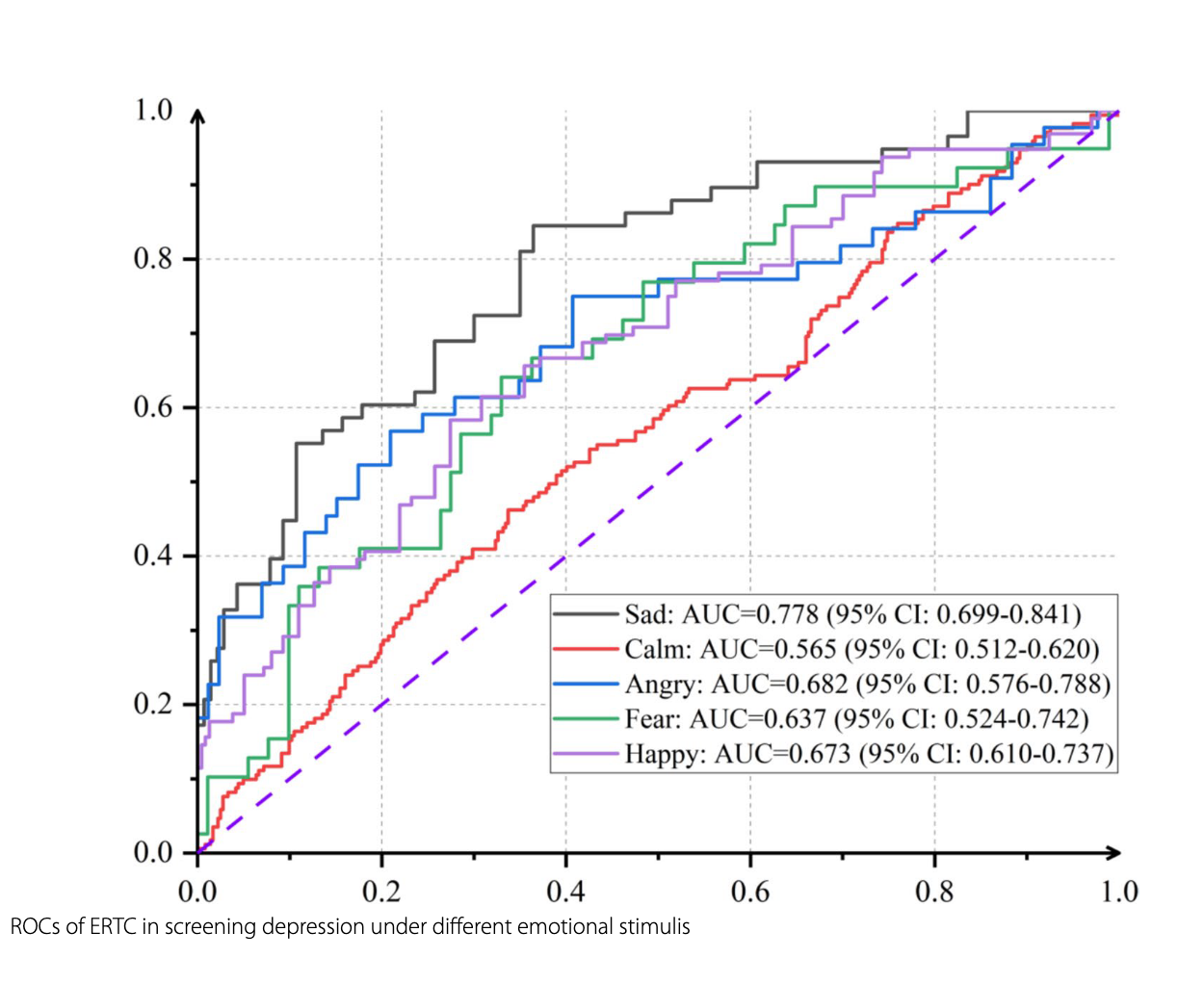

情緒特定模型表現(ERTC):sadness 最能區分 IWDs vs HCs

- 作者針對每個情緒條件各建一個 ERTC 模型,並建立 calm-state baseline,外加 logistic regression 對照。

- 結果(ERTC):

- Sadness-elicited model(最佳)

- accuracy = 76.8%(95% CI 0.707–0.823)

- AUC = 0.778(95% CI 0.699–0.841)

- Happiness

- accuracy = 73.0%(95% CI 0.682–0.775)

- AUC = 0.673(95% CI 0.610–0.737)

- Anger

- accuracy = 71.5%(95% CI 0.638–0.792)

- AUC = 0.682(95% CI 0.576–0.788)

- Fear

- accuracy = 68.5%(95% CI 0.600–0.762)

- AUC = 0.637(95% CI 0.524–0.742)

- Calm-state baseline(最低)

- accuracy = 67.9%(95% CI 0.642–0.719)

- AUC = 0.565(95% CI 0.512–0.620)

- Sadness-elicited model(最佳)

- 解讀:

- 「情緒誘發下的 HRV」比「平靜/靜息」更能提供可分類訊息

- 悲傷條件的 discriminative validity 最強,支持 IWDs 對悲傷刺激更敏感(生理反應更放大)