0) 中心化公式

本次 quadratic model 使用:

cBeta1 = Beta1 - mean(Beta1)cBeta1² = (Beta1 - mean(Beta1))²

這樣做的目的,是降低 Beta1 與 Beta1² 之間的共線性,讓模型參數更穩定、也比較好解釋。

補充檢查:

- 原始

Beta1與Beta1²的相關:r = 0.9696 - 中心化後

cBeta1與cBeta1²的相關:r = 0.5756 - quadratic model 的

VIFBAI_T1 = 6.3550BDI_T1 = 6.7963cBeta1 = 1.4354cBeta1_sq = 1.6007

解讀:

- 中心化後,

Beta1與平方項的相關明顯下降。 cBeta1與cBeta1_sq的VIF都低,表示平方項本身沒有嚴重共線性問題。

1) 巢套邏輯斯迴歸:linear vs quadratic

| 模型 | log-likelihood | AIC | BIC |

|---|---|---|---|

| linear | -20.3362 | 48.6724 | 56.6284 |

| quadratic | -17.0909 | 44.1817 | 54.1267 |

| interaction | -18.8960 | 49.7919 | 61.7258 |

| full | -16.3485 | 46.6971 | 60.6200 |

重點:

quadratic的AIC / BIC都比linear小,表示加上平方項後,模型複雜度雖然增加,但整體仍較划算。interaction單獨加入後沒有比linear更好。

2) 二次項係數(cBeta1_sq)

quadratic 模型係數:

cBeta1 = 0.7659,p = 0.2016cBeta1_sq = -0.5554,p = 0.0631

解讀:

- 平方項方向是負的,比較接近「倒 U 型」關係。

p = 0.0631屬於邊緣顯著,單看這個係數本身,證據不算最強。- 但因為整體模型比較(見下方

LR test)有顯著,所以不能只看這一個p值。

3) Likelihood ratio test(模型整體比較)

| reduced | full | LR stat | df | p |

|---|---|---|---|---|

| linear | quadratic | 6.4907 | 1 | 0.0108 |

| linear | interaction | 2.8805 | 2 | 0.2369 |

| quadratic | full | 1.4847 | 2 | 0.4760 |

| linear | full | 7.9753 | 3 | 0.0465 |

重點:

linear -> quadratic的p = 0.0108,支持加上平方項後,整體模型顯著改善。linear -> interaction不顯著,表示單純加交互作用沒有明顯幫助。quadratic -> full不顯著,表示在已有平方項後,再加交互作用沒有額外明顯增益。

4) 交叉驗證與 LOSO

| 模型 | 10-fold OOF AUC | Brier | Log loss | Calibration intercept | Calibration slope | LOSO AUC |

|---|---|---|---|---|---|---|

| linear | 0.8902 | 0.1380 | 0.4578 | -0.6062 | 0.8772 | 0.9008 |

| quadratic | 0.9323 | 0.1077 | 0.3853 | -0.4909 | 1.0533 | 0.9338 |

| interaction | 0.9023 | 0.1331 | 0.4388 | -0.5827 | 0.9305 | 0.9068 |

| full | 0.9368 | 0.1065 | 0.3816 | -0.4708 | 1.0758 | 0.9338 |

重點:

quadratic的10-fold AUC與LOSO AUC都高於linearquadratic的Brier與log loss也都比linear低,表示不只排序更好,機率預測也更穩。calibration方面,quadratic的 slope 更接近 1,整體比linear更接近理想狀態。

5) Overfitting檢查:bootstrap optimism correction

| 模型 | apparent AUC | mean optimism | optimism-corrected AUC |

|---|---|---|---|

| linear | 0.9263 | 0.0168 | 0.9095 |

| quadratic | 0.9504 | 0.0132 | 0.9371 |

| interaction | 0.9338 | 0.0187 | 0.9151 |

| full | 0.9564 | 0.0177 | 0.9387 |

重點:

quadratic的 optimism-corrected AUC 仍高於linear。- 表示平方項的增益不是只出現在 apparent fit,比較不像只是 sample-specific overfitting。

6) interaction 分開測

| 模型 | interaction term | term p | AIC | BIC | LR vs linear p |

|---|---|---|---|---|---|

linear + Beta1 × BAI | cBAI_x_cBeta1 | 0.3053 | 49.6831 | 59.6280 | 0.3199 |

linear + Beta1 × BDI | cBDI_x_cBeta1 | 0.1091 | 47.8062 | 57.7511 | 0.0905 |

解讀:

Beta1 × BAI沒有證據顯示可改善 linear model。Beta1 × BDI有一些訊號,但仍未達顯著。- 目前資料不支持「非線性主要只是來自 interaction」這個解釋。

7) spline 與 GAM

restricted cubic spline formal test

| test | reduced | full | LR stat | df | p |

|---|---|---|---|---|---|

| overall Beta1 effect | BAI + BDI | BAI + BDI + spline(Beta1) | 10.5021 | 4 | 0.0328 |

| nonlinearity beyond linear | BAI + BDI + linear(Beta1) | BAI + BDI + spline(Beta1) | 10.3588 | 3 | 0.0158 |

解讀:

-

spline model 對

Beta1的整體效果顯著。 -

nonlinearity beyond linear p = 0.0158,表示 spline 也支持「Beta1 不只是線性關係」。 -

cubic spline proxy

OOF AUC = 0.9323Brier = 0.1074Log loss = 0.3900

-

GAM`

OOF AUC = 0.9068AIC = 44.3051smooth term p = 0.00353explained deviance pseudo-R² = 0.5052

解讀:

- spline proxy 的表現與 quadratic 很接近。

GAM的 smooth term 顯著,表示即使不預設一定是平方項,資料本身仍支持Beta1和失眠之間存在非線性關係。

8) 目前最保守的結論

- 最能直接支持老師建議的主證據是:

linear vs quadratic LR test p = 0.0108 - 單看平方項係數本身是邊緣顯著:

cBeta1_sq p = 0.0631 - 但

AIC / BIC、10-fold AUC、LOSO AUC、bootstrap optimism-corrected AUC都支持 quadratic 優於 linear GAM smooth term也顯著,表示非線性不只是平方模型硬套出來的結果- 分開測

Beta1 × BAI與Beta1 × BDI後,也沒有比平方項更強的證據 - spline 的 formal nonlinearity test 亦顯著,表示 quadratic、spline、GAM 三條證據方向一致

九、圖片

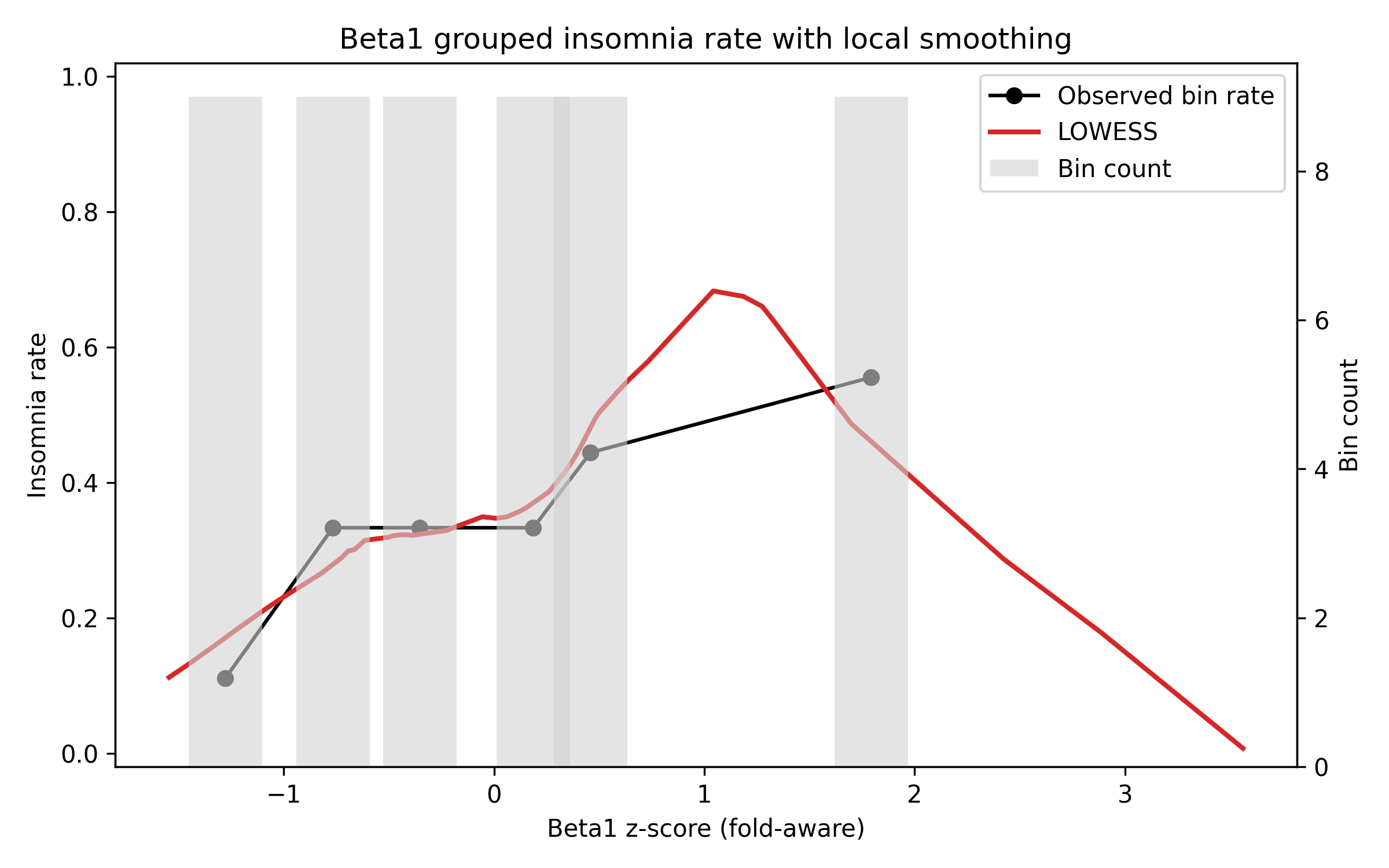

Fig 1. Beta1 分組失眠比例 + LOWESS

- 高端尾巴(z-score:1~3)樣本數比較少,可能要比較謹慎解讀?

- LOWESS 在高端有下降傾向

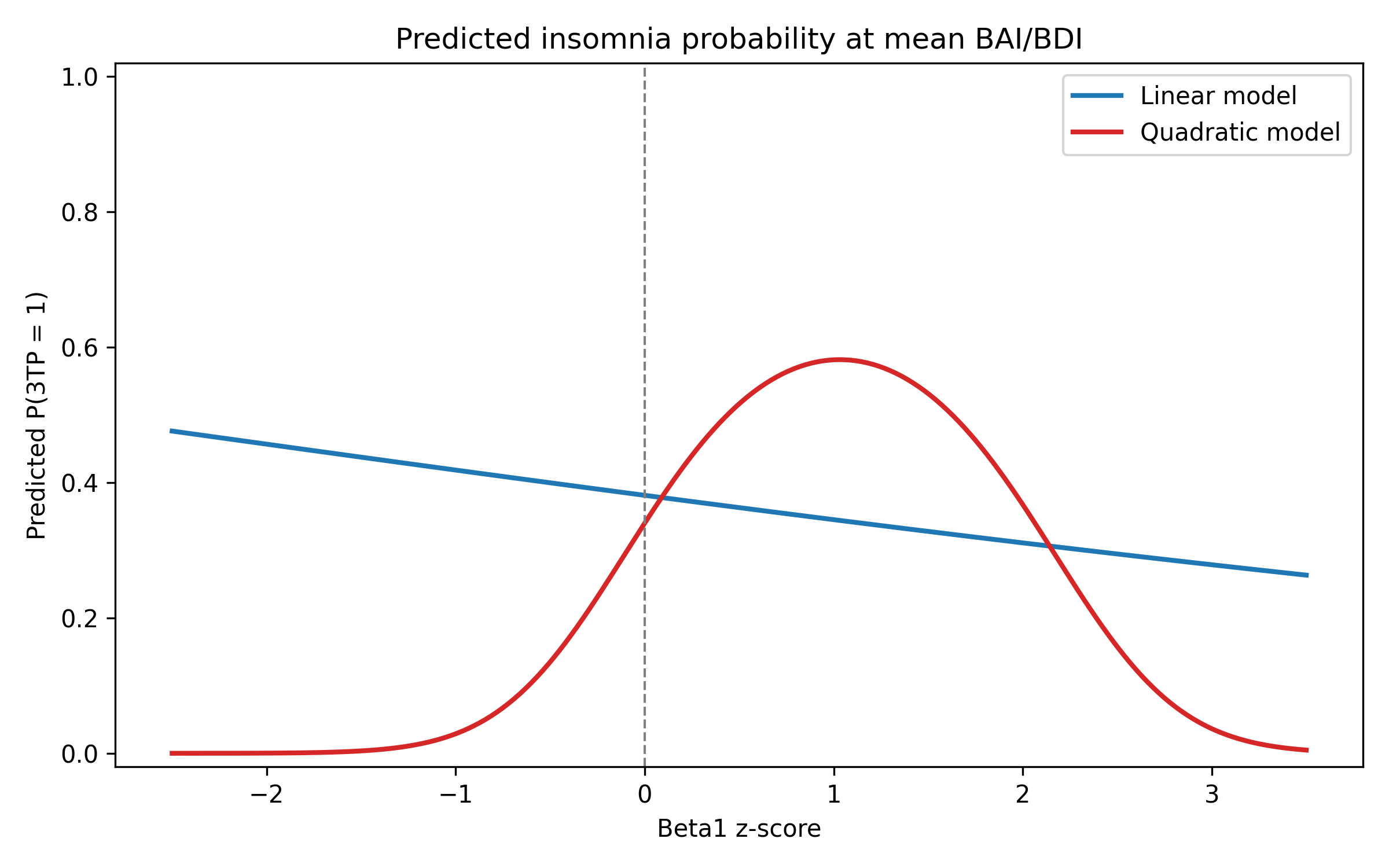

Fig 2. 固定 BAI/BDI 平均值時的 linear vs quadratic 預測機率曲線

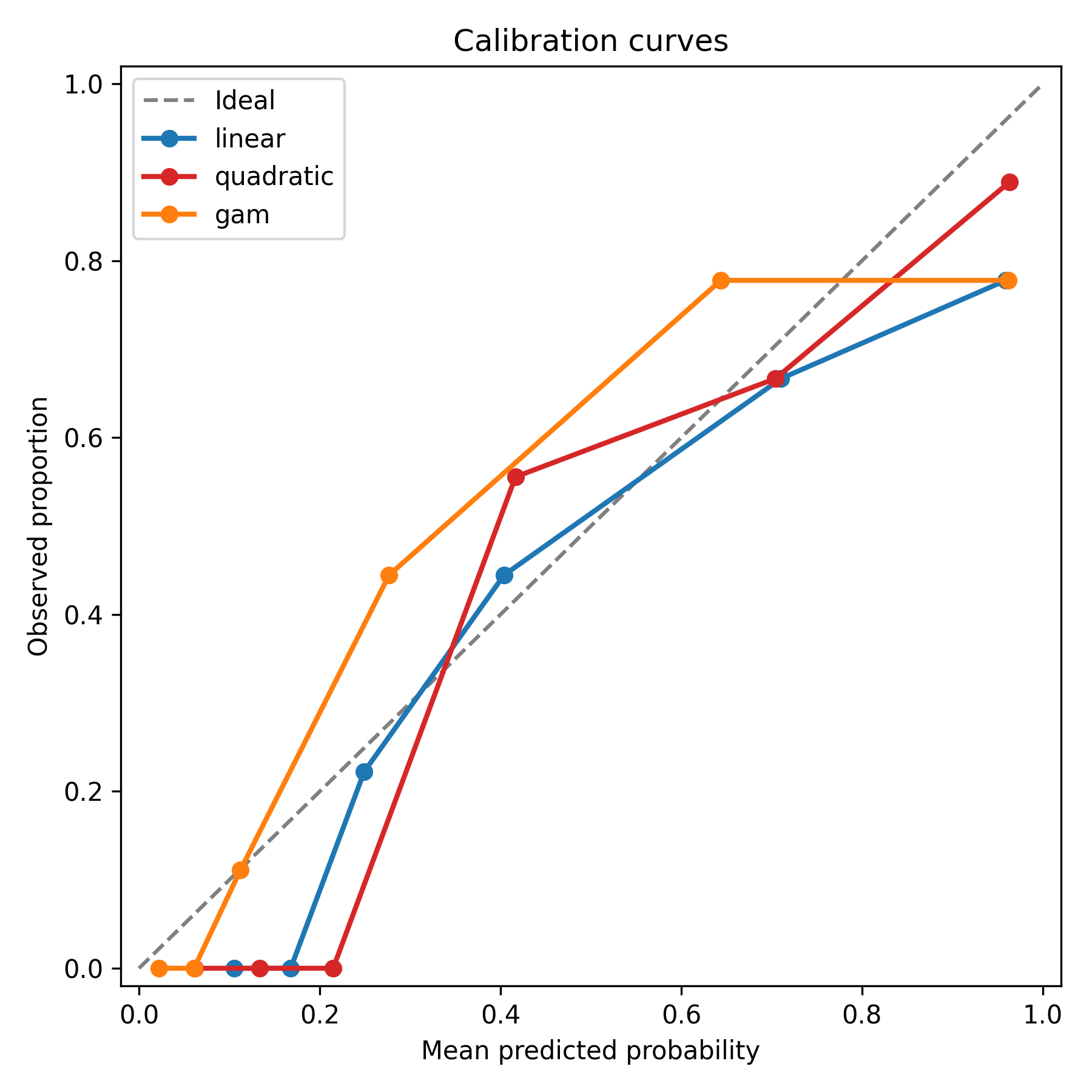

Fig 3. Calibration curve

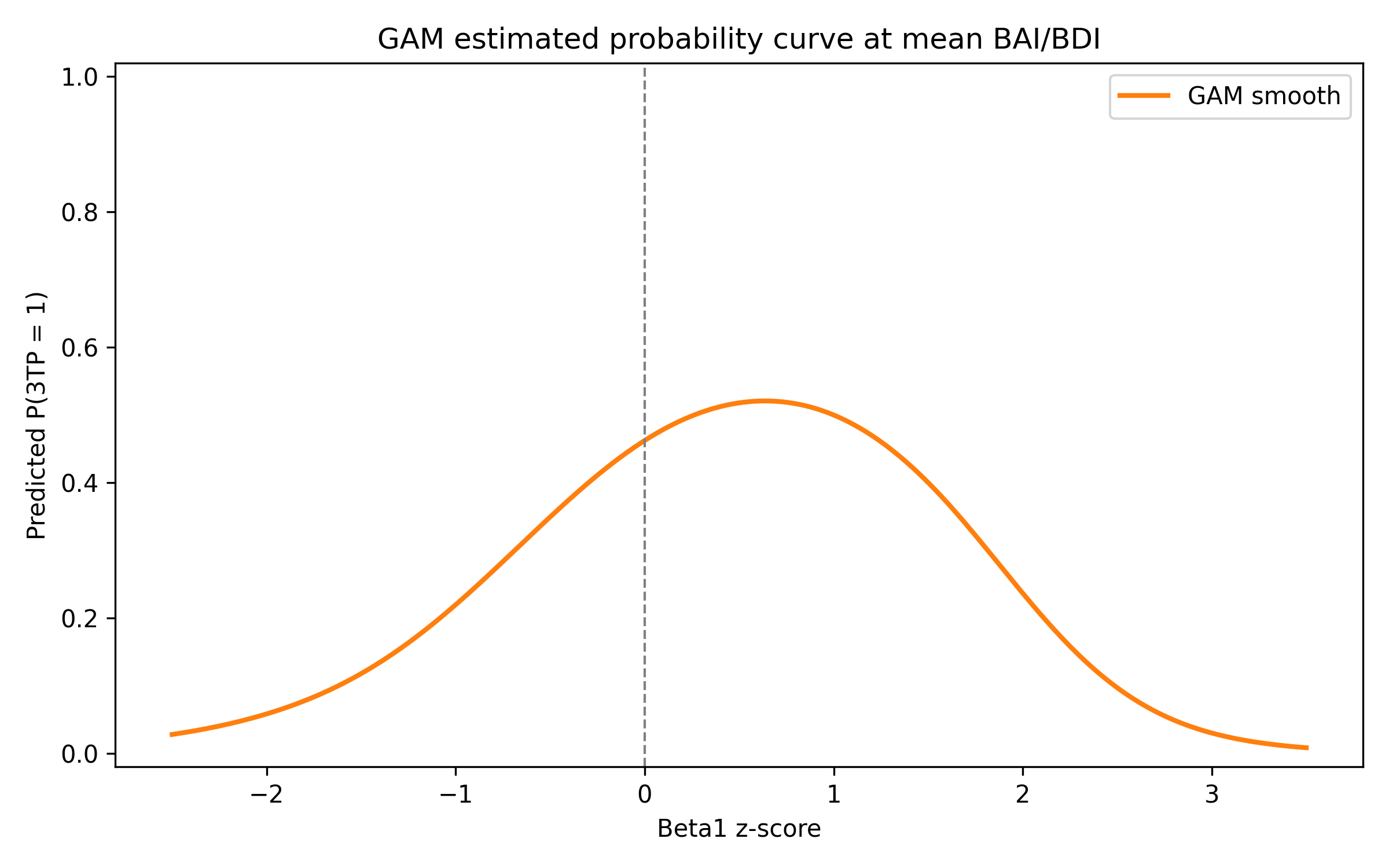

Fig 4. GAM probability curve